Table des matières

Une vue générale de la communication orale

maj 03-06-16

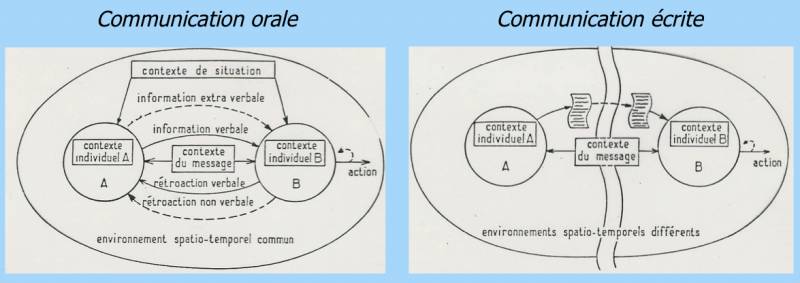

Communication parlée, communication écrite

La communication orale est située et interactive

Dans une situation naturelle - sans système électroacoustique de transmission du son - les interlocuteurs sont à portée de voix, c'est-à-dire à proximité l'un de l'autre. Contexte et situation sont partagés. L'interaction est permanente et instantanée. La modalité orale, dont voix et parole ne sont qu'une partie, est le plus souvent accompagnée de la modalité visuelle qui permet une transmission simultanée d'informations gestuelles ou posturales. Par conséquent les éléments de langage utilisés peuvent être flous, lacunaires ou bruités, sans que la transmission d'information au niveau conceptuel en soit altérée.

Par contraste l'écrit permet de communiquer à distance, dans l'espace ou dans le temps. L'absence de contexte commun et l'impossibilité d'interagir instantanément font que les éléments de langage doivent être explicites et parfaitement définis pour les deux parties.

Deux rôles de la communication par le langage

1. Transmettre des connaissances: l'écrit:

- permet d'accumuler les connaissances

- favorise la connaissance abstraite, détachée de la situation concrète

- met en oeuvre des éléments bien définis

- mais ne code pas les informations liées au contexte et à la situation

2. Synchroniser des comportements ou des cheminements de pensée: l'oral

- coopère avec d'autres modalités: geste, regard, vision

- permet d'échanger des informations situées, affectives, instantanées

- ne nécessite pas des signaux acoustiques parfaits

La parole n'est pas de l'écrit oralisé: il est vain d'y rechercher les éléments de langage précis qui sont l'apanage de l'écrit

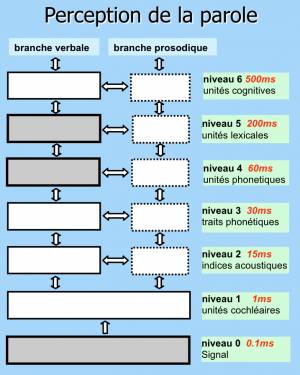

Hiérarchie structurelle du signal de parole

La figure ci-contre représente l'organisation de la perception de la parole. Ce schéma hiérarchique comporte deux branches, l'une traitant l'information linguistique (ou verbale) et l'autre l'information non linguistique, portée surtout par une partie de la prosodie. Les deux branches sont en interaction à tous niveaux. L'information circule dans les deux sens, ascendant et descendant. Plus on s'élève dans la hiérarchie, plus les informations traitées ont un caractère abstrait, global, indépendant, prédictif.

Le schéma intègre les processus de perception (niveaux 1 à 4) et de compréhension (niveaux 5 et 6).

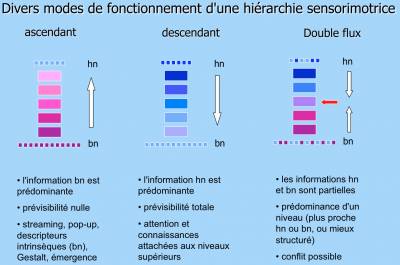

En fonctionnement purement ascendant le système cognitif et les autres modalités ne fournissent aucune anticipation et le signal est traité niveau par niveau, de bas en haut; ce processus est lent et susceptible de faire des erreurs si le signal est altéré.

En fonctionnement purement descendant aucune information n'est extraite du signal. Le système cognitif est certain de ce qui va arriver. Ce processus est rapide mais produit des erreurs assimilables à des illusions perceptives.

Dans les conditions usuelles le système cognitif fait une anticipation partielle, basée sur ses connaissances de haut niveau, et le signal, lui-même incertain ou entaché de bruit, apporte des confirmations partielles. Il s'établit un équilibre dynamique, les traitements ascendants et descendants convergeant (ou entrant en conflit) à un niveau variable à chaque instant en fonction de la situation, des connaissances disponibles à tous niveaux et des signaux de parole à traiter.

Détail d'une hiérarchie de traitement d'information perceptive ou motrice

Organisation sensorimotrice d'un système cognitif naturel ou artificiel

Le système cognitif est censé avoir de grands buts à long terme, tels que la survie, la reproduction etc. Mais à chaque instant il doit décider ou exécuter de petites actions dans des buts plus modestes - garder l'équilibre, avancer dans telle direction, saisir tel objet utile à son dessein du moment etc, et rester à l'écoute du monde tout en suivant son cheminement de pensée. Il dispose pour cela d'une grande quantité de hiérarchies sensorimotrices comparables à celles décrites plus haut pour la parole, éventuellement reliées horizontalement entre elles à même résolution temporelle.

Le système cognitif est censé avoir de grands buts à long terme, tels que la survie, la reproduction etc. Mais à chaque instant il doit décider ou exécuter de petites actions dans des buts plus modestes - garder l'équilibre, avancer dans telle direction, saisir tel objet utile à son dessein du moment etc, et rester à l'écoute du monde tout en suivant son cheminement de pensée. Il dispose pour cela d'une grande quantité de hiérarchies sensorimotrices comparables à celles décrites plus haut pour la parole, éventuellement reliées horizontalement entre elles à même résolution temporelle.

Le monde externe est celui dans lequel le système évolue. Le monde interne est celui de ses propres organes. La proprioception procède des deux, en informant le système de l'état interne des éléments corporels qui lui permettent d'agir sur le monde. Monde interne et monde externe ne sont pas faciles à distinguer: ils constituent ensemble l'environnement du système cognitif.

Conséquences pour l'analyse de la parole et de la voix

L'auditeur humain s'accommode de signaux mal définis

Dans les situations ordinaires les sons constituants de la parole sont partiellement altérés, bruités ou incomplets. Cela n'est aucunement une gêne pour l'interlocuteur humain, dans la mesure où il peut extraire du signal suffisamment d'information pour comprendre la signification du message dans son contexte. Il est aidé en cela par sa connaissance de la situation et par l'information transmise par d'autres modalités, qui lui permettent d'anticiper à tous les niveaux de perception/compréhension. De plus il a en général la capacité d'interagir instantanément avec l'interlocuteur.

Les systèmes artificiels cherchent une information absente du signal

Il n'en va pas de même pour les systèmes contemporains de reconnaissance de la parole ou du locuteur, qui fonctionnent en différé, ne sont pas munis de mécanismes d'anticipation ni d'apprentissage/adaptation, et n'intègrent pas les notions de situation et d'interactivité. La conséquence en est que ces systèmes ne fonctionnent qu'à l'intérieur d'un cadre donné. Tout écart relatif au vocabulaire et à la syntaxe permis, à la prononciation apprise ou aux conditions de prise de son, entraîne des erreurs incongrues, sans rapport avec le sens du signal.

Les informations non-linguistiques contribuent à la compréhension

Les informations non-linguistiques du signal de parole, perçues par tout sujet humain au même titre que le contenu linguistique du signal, contribuent tout autant que ce dernier à la transmission de sens entre interlocuteurs. Elles sont pourtant considérées comme de simples facteurs d'incertitude (de “variabilité”) par les systèmes de reconnaissance. En niant le rôle de ces informations propres à la communication orale on augmente à l'infini la variabilité apparente de la parole et la fragilité des systèmes artificiels.

Dans quelles parties du signal se trouvent les informations non-linguistiques?

Les informations non-linguistiques ne sont pas, en général, portées par des signes ou paramètres particuliers du signal, mais plutôt par des modulations de la voix et par des déformations des entités linguistiques segmentales (phonèmes, mots, règles phonotactiques et syntaxiques) et suprasegmentales (ceux des éléments prosodiques qui sont codifiés dans la langue). Parole et voix ne sont pas des notions distinctes dans le signal; elles se distinguent l'une de l'autre progressivement, à mesure qu'on s'élève dans l'échelle des niveaux d'abstraction.

Publications sur ce sujet

principales

C54 - J-S. Liénard, 1999: “A hierarchical model of speech and voice perception based on time resolution”, XIVth Int Congress of Phonetic Sciences, San Francisco.

C53 - J-S. Liénard, 1995: “Speech Pattern Processing : integrating the linguistic and non-linguistic aspects of voice and speech”, XIIIth Int. Congress of Phonetic Sciences, Stockholm.

H10 - J-S. Liénard, 1995: “From speech variability to pattern processing : a non-reductive view of speech processing”, in “Levels in Speech Communication : relations and interactions”, eds J.Schoentgen et al., Elseviers Science Publishers.

A3 - J-S. Liénard, 1977: “Les processus de la communication parlée ; introduction à l'analyse et à la synthèse de la parole”, 189 p, ed Masson, Paris.

autres

B14 - J-S. Liénard, 2012: “La Communication Parlée, interactive et située”, Congrès Viniyoga Langage et Parole, Reims.

G13 - J-S. Liénard, 2010: “Speech processing as a situated activity”, EBIRE seminar, Martinez, Ca.

C57 - J-S.Liénard, 2002: “Speech and voice analysis according to a multiscale temporal integration model”, ISCA Workshop “Time Integration in the Processing of Speech” (TIPS), Aix en Provence.

B11 - J-S. Liénard, 2000: “Perception naturelle et perception artificielle”, Journées CNRS Neurosciences et Sciences de l'Ingénieur NSI 2000, Dinard, septembre 2000 (texte publié dans les actes).

H15 - J-S. Liénard, 1999: “Perception naturelle et perception artificielle”, in Cerveaux et Machines, Institut F.R.Bull, ed V.Bloch, Hermès Science, Paris, 65-81.

C52 - J-S. Liénard, M-G. Di Benedetto, 1995: “Characterization of the non-linguistic information of vowels by matching vowel systems”, XIIIth Int. Congress of Phonetic Sciences, Stockholm.

E13 - J-M. Hoc, J-S. Liénard, 1992: “La cognition en situation réelle”, article de présentation du chapitre “Ergonomie des Systèmes Homme-Machine” du numéro 79 du Courrier du CNRS consacré aux Sciences Cognitives, Paris.

B8 - J-S. Liénard, 1989: “Variabilité, contraintes et spécification de la parole : un cadre théorique”, actes du séminaire SFA-GCP sur la variabilité, Marseille, juin 1989 (conférence invitée, texte publié dans les actes).

C40 - J-S. Liénard, 1984: “Une approche globaliste de la variabilité de la parole”, 13e JEP, Bruxelles.

H3 - J-S. Liénard, 1980: “La lecture des ordinateurs - Ecrit et intelligence artificielle”, publié dans l'ouvrage “Cinq contributions pour comprendre la lecture” par l'Association Française pour la Lecture, Paris.